Ormai occorre fare qualche considerazione in merito ai possibili impatti dell AI nel settore legale e come l’uso di questi sistemi richiederà sempre una valutazione di impatto, prassi poco usata in questo ambito, ma oggi con questi sistemi in continua evoluzione e spinta mediatica, le attese esagerate che si stanno generando nelle persone che non capiscono cosa sia realmente il fenomeno AI, si rischiano attese eccessive e sproporzionate al loro prezioso uso, specie i sistemi MMT, che potranno produrre un sacco di disastri.

Ho assistito, nell’ambito dei miei studi del fenomeno, a lezioni dell’uso di prodotti AI come ChatGPT dove le persone, anche seri professionisti, finivano per umanizzare tali sistemi, incantati dalle risposte molto “umane” e finivano per attribuire un valore quasi oracolare alle risposte.

Ho perciò pensato di riassumere sull’argomento alcuni aspetti e ho cercato di spiegare a chi non è esperto alcune criticità e vantaggi dei sistemi AI applicati in ambito legale e conseguentemente nella Compliance e di come sia necessaria una valutazione di impatto.

Cerchiamo dunque di fare una sintetica disamina di come dovrebbe essere una necessaria valutazione di impatto dell’uso dei sistemi AI in ambito legale.

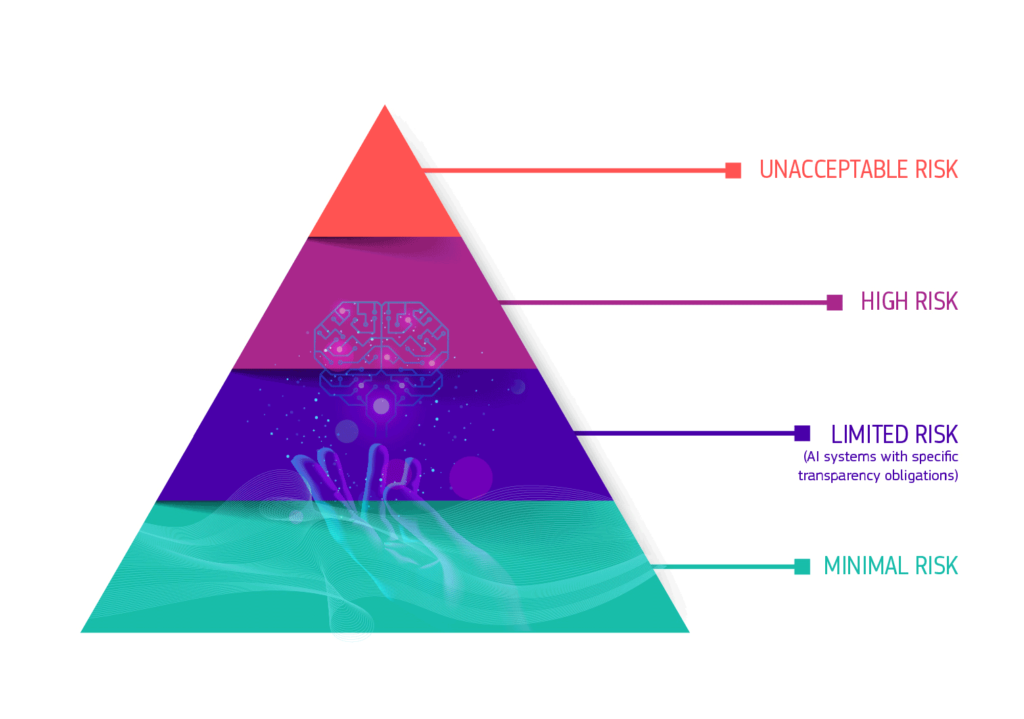

The Regulatory Framework defines 4 levels of risk in AI:

Una valutazione di impatto è un processo che viene utilizzato per identificare, valutare e mitigare i rischi associati a un progetto o a una decisione. Nel caso dell’uso dei sistemi AI in ambito legale, questa dovrebbe considerare almeno i seguenti aspetti:

- Impatto sui diritti umani: l’uso può alterare alcuni diritti come il diritto alla privacy, il diritto alla non discriminazione e il diritto al giusto processo. È importante valutare questi impatti e adottare misure per mitigarli.

- Impatto sull’equità: il rischio ad esempio se sono utilizzati in modo discriminatorio o se portano a un aumento delle disuguaglianze. È importante valutare questi impatti e adottare misure per promuovere l’equità.

- Impatto sulla trasparenza: I sistemi AI dovrebbero essere trasparenti e comprensibili. È importante valutare la trasparenza dei sistemi AI e adottare misure per migliorare la loro comprensibilità.

- Impatto sulla responsabilità: I sistemi AI dovrebbero essere responsabili. È importante valutare la responsabilità dei sistemi AI e adottare misure per garantire che siano responsabili delle loro azioni.

- Impatti occupazionali: questi sistemi sono in grado di sostituirsi in tutte quelle attività di tipo ricorrente o definite da un processo di svolgimento molto preciso e nelle attività in cui si forniscono indicazioni, risposte o si deve organizzare dei calendari.

Tali sistemi possono comprendere i contenuti normativi e verificare eventuali incongruenze logiche e/o procedurali legati alle varie norme di legge fornendo coì una lettura organica e una visione di dove si può intervenire per linearizzare e integrare i vari temi normativi.

Vi possono essere vari tipi di potenziali impatti positivi e negativi dell’uso dei sistemi AI in ambito legale ad esempio si possono intuire:

Impatti positivi:

- Miglioramento dell’efficienza e dell’efficacia del sistema legale: I sistemi AI possono automatizzare attività ripetitive e laboriose, liberando i professionisti legali per concentrarsi su attività più complesse e strategiche.

- Miglioramento dell’accesso alla giustizia: I sistemi AI possono rendere il sistema legale più accessibile a persone e imprese che non possono permettersi di assumere un avvocato.

- Miglioramento della precisione e della coerenza delle decisioni legali: I sistemi AI possono essere utilizzati per analizzare grandi quantità di dati e identificare modelli che i professionisti legali potrebbero non essere in grado di identificare.

Impatti negativi:

- Pregiudizio: I sistemi AI possono essere soggetti a pregiudizi, che possono portare a discriminazioni nei confronti di determinate categorie di persone.

- Perdita di posti di lavoro: L’uso dei sistemi AI potrebbe portare alla perdita di posti di lavoro per i professionisti legali.

- Abuso: I sistemi AI potrebbero essere utilizzati per scopi illegali o dannosi.

In una valutazione di impatto dovrebbe considerare tutti questi aspetti, sia positivi che negativi, per identificare i rischi associati all’uso dei sistemi AI in ambito legale. Sulla base della valutazione, sarà poi possibile adottare misure per mitigare i rischi, gli effetti distorsivi e negativi e promuovere i benefici dell’uso dei sistemi AI.

Per guidare una valutazione di impatto dell’uso dei sistemi AI in ambito legale potrebbero rendersi necessarie delle domande che aiutino a stimolare una riflessione profonda, allontanando la visione fideistica e antropomorfa che molti stanno assumendo, specie con le AI di tipo LLM, e porci domande di questo tipo:

- Quali sono i potenziali benefici dell’uso dei sistemi AI in ambito legale?

- Quali sono i potenziali rischi dell’uso dei sistemi AI in ambito legale?

- Quali sono le misure che possono essere adottate per mitigare i rischi dell’uso dei sistemi AI in ambito legale?

La valutazione dovrebbe essere effettuata da un team di esperti, con competenze in ambito legale, tecnologico, organizzativo, politico e etico. La valutazione dovrebbe essere documentata e resa pubblica in modo da consentire a tutti di contribuire alla discussione sull’uso dei sistemi AI in ambito legale.

L’intelligenza artificiale (AI) può quindi avere anche un impatto significativo sulle attività di compliance rispetto a come sono svolte sino ad oggi nella maggioranza delle organizzazioni, i cui effetti sia positivi che negativi possono sommariamente essere:

Effetti positivi

L’AI può quindi essere utilizzata per migliorare l’efficienza e l’efficacia delle attività di compliance in diversi modi, tra cui:

- Rendere efficiente l’attività di scouting normativo, analizzare le interazioni con i processi e regolamenti interni delle varie norme, rilevare e armonizzare le differenti norme in una forma aggregata e sviluppare die piani di compliance per le specificità di ogni singola organizzazione, inoltre può rilevare le criticità normative quando si opera su più stati con peculiarità normative diverse.

- Automatizzazione di attività ripetitive e laboriose: L’AI può essere utilizzata per automatizzare attività come la raccolta e l’analisi dei dati, la revisione dei contratti e la valutazione dei rischi. Questo può liberare i professionisti della compliance per concentrarsi su attività più complesse e strategiche.

- Miglioramento della precisione e della coerenza delle decisioni: L’AI può essere utilizzata per analizzare grandi quantità di dati e identificare modelli che i professionisti della compliance potrebbero non essere in grado di identificare (compliance intelligence). Questo può migliorare la precisione e la coerenza delle decisioni di compliance.

- Miglioramento dell’accesso alla compliance: L’AI può essere utilizzata per rendere le attività di compliance più accessibili a persone e imprese che non hanno le risorse per assumere un consulente di compliance specie per le attività di gestione ordinaria.

Effetti negativi

L’AI può anche avere alcuni effetti negativi sulle attività di compliance, tra cui:

- Pregiudizio: L’AI può essere soggetta a pregiudizi, che possono portare a discriminazioni nei confronti di determinate categorie di persone.

- Perdita di posti di lavoro: L’uso dell’AI potrebbe portare alla perdita di posti di lavoro per i professionisti della compliance.

- Abuso: L’AI potrebbe essere utilizzata per scopi illegali o dannosi.

- BIAS: l’AI può essere soggetta allo sviluppo di BIAS negli algoritmi che genera autonomamente pertanto tali criteri e algoritmi di decisione devono poter essere letti, trasparenti e del caso modificabili.

In conclusione l’AI ha il potenziale di rivoluzionare le attività della compliance. Tuttavia, è importante essere consapevoli dei potenziali rischi associati all’uso di questa e adottare misure per mitigarli.

Alcuni dei consigli per utilizzare l’AI in modo sicuro ed efficace per le attività di compliance possono essere:

- Valutare l’impatto dell’AI: Prima di implementare qualsiasi sistema AI per le attività di compliance, è importante valutare l’impatto potenziale dell’AI, sia positivo che negativo.

- Utilizzare l’AI in modo responsabile: I sistemi AI dovrebbero essere utilizzati in modo responsabile e rispettoso dei diritti umani.

- Formare i dipendenti: I dipendenti dovrebbero essere formati sull’uso dei sistemi AI e sui potenziali rischi associati.

- Formare i Compliance Manager e gli addetti ai vari compiti di compliance all’uso di questi strumenti di analisi basati su sistemai AI

Seguendo questi consigli, le organizzazioni possono utilizzare l’AI per migliorare l’efficienza e l’efficacia delle attività di compliance, riducendo al contempo i rischi associati.

Per chi volesse approfondire questi temi di seguito riporto una sintetica bibliografia per una panoramica dell’impatto dell’AI sulle attività di compliance. I libri e gli articoli forniscono approfondimenti sul potenziale dell’AI per migliorare le attività di compliance, nonché sui potenziali rischi associati. Il report fornisce una panoramica globale dell’uso dell’AI nelle attività di compliance.

Per approfondimenti, consultare i seguenti link e/o riferimenti:

- Libri:

- Artificial Intelligence in Compliance: A Guide for Practitioners, di Michael C. Thomsett (2022)

- The Impact of Artificial Intelligence on Compliance: Opportunities and Challenges, di Kevin J. O’Brien e Michael C. Thomsett (2020)

- Artificial Intelligence for Compliance: A Practical Guide, di David R. Aiken (2019)

- How to Stay Smart in a Smart World: Why Human Intelligence Still Beats Algorithms – Gerd Gigerenzer (2023)

- Articoli:

- The Impact of Artificial Intelligence on Compliance, di Kevin J. O’Brien e Michael C. Thomsett (2019)

- The Potential of Artificial Intelligence to Improve Compliance, di Thomas P. O’Malley (2018)

- The Risks of Artificial Intelligence in Compliance, di Michael C. Thomsett (2017)

- Report:

- Artificial Intelligence and Compliance: A Global Perspective, di PwC (2022)

- The Impact of Artificial Intelligence on Compliance: A Survey of Global Compliance Professionals, di Thomson Reuters (2021)

- The Future of Compliance: How Artificial Intelligence Will Transform the Way We Do Compliance, di EY (2020)

- Un approccio europeo all’intelligenza artificiale

- Proposta di REGOLAMENTO che stabilisce regole armonizzate sull’intelligenza artificiale (Legge sull’intelligenza artificiale) e modifica alcuni atti legislativi dell’UE, Parlamento e Consiglio UE | 2021/0106/COD